취재 | 음성언어처리 기술의 현재와 미래를 살펴보다

“시리야, 랩 해줘” “알겠습니다... 자, 갑니다. 제가 작사했어요.”

사람이 기계와 음성으로 대화하는 모습은 이미 익숙해진 지 오래다. 이런 대화형 개인 비서 에이전트, AI 스피커 등은 음성언어처리기술을 기반으로 만들어졌다. 많은 대기업에서 음성언어처리기술에 막대한 금액을 투자하고 있고, 관련 제품도 끊임없이 개발돼 출시되고 있다. 『대학신문』은 음성언어처리기술이 주목을 받는 상황에서 이 기술의 원리를 짚어보고 현황과 앞으로의 발전 가능성을 알아보고자 한다.

음성언어처리기술은 인간이 사용하는 언어와 의사소통 방식을 기반으로 한다. 사람들 사이의 소통을 기계가 돕거나, 기계와 인간 사이 소통을 도와주는 통로로써 음성언어처리기술이 사용되기 때문이다. 정민화 교수(언어학과)는 “이는 언어현상에 대한 기본적 이해를 필요로 한다”고 덧붙였다. 이런 음성언어처리과정은 음성을 텍스트로 변환하는 음성신호처리와 변환된 텍스트를 컴퓨터에 이해시키는 자연언어처리로 구분된다. 자연언어처리는 형태소 분석, 구문분석으로 나뉜다. 강승식 교수(국민대 컴퓨터공학부)는 “형태소 분석은 조사, 어미를 분리하고 동사, 명사 품사를 인식하는 과정”이고 “구문분석은 ‘~을’은 목적어, ‘~은/는’은 주어 등 문장의 구성성분과 형태소 분석 정보로 문장 구조를 분석하는 과정”이라고 설명했다. 최종적으로 문장 분석 결과가 나오면 컴퓨터는 문장을 ‘이해’한 것이다. 그리고 이해한 문장 의도에 따라 컴퓨터는 행동한다. 예를 들면 “오늘 날씨가 어때?”라고 물어보면 기상청 사이트에 연결해 날씨 정보를 제공해주는 식이다.

음성언어처리기술을 기반으로 한 인터페이스 중 가장 대표적이며 널리 알려진 것은 아이폰의 인공지능 비서 프로그램인 ‘시리’다. 2011년 시리가 처음으로 아이폰에 탑재돼 출시된 이후 다양한 기업에서 비슷한 프로그램을 내놨다. 하지만 시리가 음성언어처리기술을 이용한 첫 시도는 아니다. 정민화 교수는 “2000년대 초반 미국에선 음성언어처리기술을 이용해 자동화하는 것이 가장 큰 규모의 시장이었다”고 말했다. 실제로 미국에선 A/S 센터, 항공권 예약 등 다양한 분야를 전화로 처리해왔다. 고객이 전화를 걸어 필요한 정보를 음성으로 제공하면 컴퓨터가 음성을 처리하고 이해한 후 부족한 정보는 다시 물어보고, 정보가 충분하면 업무를 수행하는 식이다. 시장이 성장하며 더욱 발전한 언어처리기술은 시리는 물론 AI 스피커의 등장에도 큰 영향을 미쳤다. 특히 AI 스피커 중 하나인 ‘아마존 에코’는 우수한 원거리 음성인식 및 처리 능력을 보여줬다.

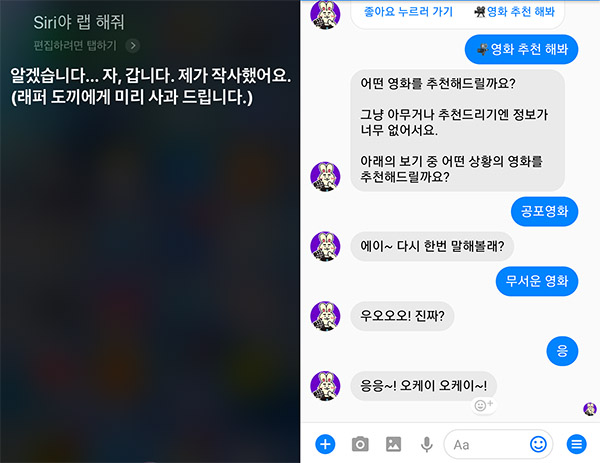

이런 발전 속도는 음성언어처리기술이 나날이 성장하면서 더욱 빨라질 것으로 예상된다. 정민화 교수는 “기술 수준이 높아지면서 컴퓨터가 언어 이해에만 그치지 않고 실제 서비스까지 연결하는 응용도 가능해졌다”고 말했다. 대표적인 예가 메신저 기반 환경에서 사용자의 요구·질문을 들어주는 ‘챗봇’ 서비스다. 챗봇은 사람들이 평소 쓰는 메신저 속에서 활동하기 때문에 따로 앱을 실행하지 않더라도 챗봇과 대화하면서 필요한 정보를 얻거나 일을 수행할 수 있다. 정민화 교수는 “이미 많은 미국 브랜드들은 자신의 챗봇을 만들고 이를 자신의 콘텐츠에 연결하고 있다”고 말했다. 한국에서도 대형 쇼핑몰, 은행, 영화관 등 많은 분야에서 챗봇 서비스가 제공되고 있다. 이밖에도 음성언어처리기술은 신체 장애로 인해 음성을 제대로 내지 못하는 장애인을 위한 인터페이스(보완대체의사소통), 몸짓과 음성이 결합한 공감각적 방식 등 여러 분야에 사용될 수 있다. 정민화 교수는 스티븐 호킹을 예로 들며 음성언어처리기술이 말하기 힘든 사람의 의사소통을 도와주는 역할을 할 수 있다고 설명했다.

물론 아직은 기술적 한계가 존재한다. 우선 기기가 음성을 인식할 때 방해되는 잡음 처리가 완벽하지 않다. 정민화 교수는 “사람도 시끄러운 소리가 섞여 있으면 대화를 구분하기 힘들다”며 잡음처리의 어려움을 지적했다. 강승식 교수는 이에 동의하면서도 “잡음처리기술이 많이 발전했다”며 신조어나 고유명사 인식률이 떨어지는 점이 더 문제라고 지적했다. 음성처리의 핵심 알고리즘은 ‘학습’이다. 하지만 끊임없이 만들어지는 신조어와 수많이 존재하는 고유명사는 학습하기 어렵다. 이는 컴퓨터의 저조한 언어 인식률로 이어진다. 그 밖에 방언, 사용자마다 다른 목소리나 억양도 학습이 어렵다.

이처럼 음성언어처리기술을 둘러싼 주요한 기술적 문제에 대한 의견은 전문가마다 다르다. 기술적 문제가 해결되는 건 시간문제라 보는 입장이 있는가 하면 음성을 인식하고 처리하는 모든 과정에 오류가 생길 수 있기 때문에 완벽한 음성언어처리기술로 만드는 것은 어렵다는 견해도 존재한다. 그럼에도 음성언어처리기술은 끊임없이 오류를 수정하며 발전하고 있다. 이미 보완대체의사소통, 공감각적 서비스 등 많은 분야에서 언어처리기술의 데모버전이 진행되는 등 다양한 분야로 진출하며 시장의 규모도 계속 커지고 있다. 사람이 사람뿐만 아니라 컴퓨터와 자유로이 대화를 나누고 일을 처리하는 미래는 그리 멀지 않은 곳에 있다.

(우) 기자가 ‘페이스북 메신저’ 기반 영화 추천 챗봇 ‘무비’와 직접 대화를 나눠봤다. 무비는 대화를 바탕으로 사용자가 원하는 영화 정보를 얻어 영화를 추천해주는 방식으로 운영되는데 언어인식률은 낮은 편이다.